なぜAIの組織導入は難しいのか?

個人利用との違い、そして従来のITソリューションとの違い

AI、特に生成AIはビジネスに革命をもたらす可能性を秘めています。しかし、多くの組織がその導入に苦戦し、プロジェクトの失敗率は驚くほど高いのが現実です。ここでは、その「難しさ」の正体を、技術的な問題だけでなく、データ、人材、コスト、文化といった多角的な視点から解き明かします。

AI導入を阻む5つの壁

データという難問

AIはデータを「燃料」とします。そのため、データに関する問題はプロジェクトの成否を左右する最も根本的な課題です。「ゴミを入れればゴミが出る」原則は絶対です。

品質と量: 不正確・不完全なデータ、量の不足はAIの性能を著しく低下させます。データ収集・クレンジング・前処理には膨大な労力がかかります。

バイアス(偏り): 学習データに潜む歴史的・社会的な偏りは、AIに引き継がれ不公平な判断を生むリスクがあります(例:過去の採用データに基づく性別バイアス)。

プライバシーとセキュリティ: 個人情報や機密情報の漏洩リスクは常に伴います。GDPR等の法規制遵守は必須であり、違反には高額な罰金が科される可能性があります。

ガバナンス: AIに特化したデータ管理体制の欠如が、多くの組織で課題となっています。データの正確性、プライバシー、倫理的利用を担保する仕組みが必要です。

「ヒト」という要因

最先端の技術や豊富なデータがあっても、それを扱う「ヒト」と「組織」が伴わなければAI導入は成功しません。

人材とスキルギャップ: データサイエンティスト不足だけでなく、全社的なAIリテラシーの欠如が問題です。AIの出力を正しく理解し活用する能力が全従業員に求められます。

組織文化と変化への抵抗: 「仕事が奪われる」という恐怖、新しいスキル習得への不安、AIへの不信感が抵抗を生みます。これは多くの場合、経営層のコミュニケーション不足への合理的な反応です。

経営層の理解不足: 明確なAI戦略の欠如はプロジェクト失敗の主因です。「AI導入」自体が目的化し、解決すべきビジネス課題が曖昧なまま進むケースが後を絶ちません。

部門間の連携不足: IT、データ、ビジネス各部門の「サイロ化」が連携を阻害し、データの分断やプロジェクトの遅延を引き起こします。

コストという難題

AI導入の魅力の裏には、現実的なコスト問題が常に存在します。投資対効果(ROI)の不確実性は、導入を躊躇させる大きな要因です。

高額な初期費用: 高性能なハードウェア(GPU)、専門ソフトウェア、専門人材の採用、学習データの準備など、多額の初期投資が必要です。

継続的な運用コスト: AIモデルは「生き物」です。性能を維持するための監視、再学習、インフラ運用など、導入後も継続的にコストが発生し、しばしば過小評価されます。

ROI測定の難しさ: AIの効果には、コスト削減のような直接的なものに加え、意思決定の質の向上など、定量化が難しい「見えにくい利益」が多く含まれます。

投資の正当化: 短期的なROIを示せないことが、経営層からの予算獲得やプロジェクト継続の障壁となるケースが非常に多いです。

技術的・運用的ハードル

データや人材の問題に加え、純粋な技術面や運用面でも多くの困難が伴います。

既存システムとの統合: 古い基幹システム(レガシーシステム)との連携は技術的に非常に複雑で、多くのプロジェクトで大きな障壁となります。

「ブラックボックス」問題: AIが「なぜその判断をしたのか」を説明できない問題です。これはユーザーの信頼を損ない、原因究明を困難にし、規制遵守の障害となります。説明可能なAI(XAI)が求められます。

モデルの維持管理とドリフト: 市場環境の変化などにより、AIモデルの性能は時間と共に劣化します(モデルドリフト)。継続的な監視と再学習が不可欠です。

MLOpsの欠如: AIモデルの開発から運用までを効率化するMLOps体制の未整備が、多くの組織でモデルの品質維持を困難にしています。

倫理・責任という課題

AIの活用は、その利便性の裏で様々な倫理的課題をもたらします。組織は責任ある姿勢で臨むことが不可欠です。

公平性・説明責任・透明性: AIが特定の属性を持つ人々を不当に扱わない「公平性」、判断の根拠を説明できる「透明性」、結果に責任を負う「説明責任」の確保が重要です。

ハルシネーション: AIが事実に基づかないもっともらしい嘘を生成する現象。これを信じると誤った意思決定につながる重大なリスクがあります。

著作権とセキュリティ: 学習データに含まれる著作物の扱いや、AI生成物の権利帰属は法的に複雑です。また、プロンプト攻撃など新たなセキュリティ脅威も出現しています。

倫理的人材の不足: これらの複雑な問題を理解し、実践的な対策を講じられる専門家が組織内に不足していることが、倫理的なAI導入のボトルネックとなっています。

2つの根本的な違いを理解する

AIの組織導入の難しさは、「個人での手軽なAI利用」と「従来のITシステム開発」という過去の成功体験とのギャップから生じます。

組織のAI導入 vs 個人のAI活用

個人のAI活用 (例: ChatGPT)

目的: 個人の生産性向上、情報収集

データ: Web上の公開情報、自己入力

システム統合: ほぼ不要

コスト: 低コストまたは無料

リスク: 個人レベル(誤情報など)

ガバナンス: 不要

導入容易度: 非常に容易

組織のAI導入

目的: 競争優位性確立、プロセス変革

データ: 大量の社内機密データ

システム統合: 既存システムとの複雑な連携が必須

コスト: 高額な初期・運用コスト

リスク: 組織全体(経営判断ミス、法的責任)

ガバナンス: 厳格な体制が不可欠

導入容易度: 非常に複雑、長期間

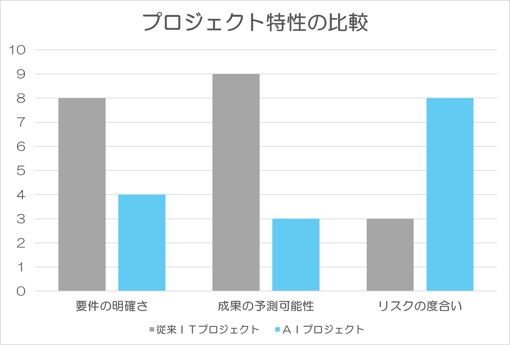

AIプロジェクト vs 従来のITプロジェクト

AIプロジェクトは、計画通りに進める従来のITプロジェクトとは根本的にパラダイムが異なります。データが中心であり、実験的で不確実性が高いのが特徴です。

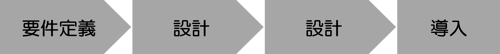

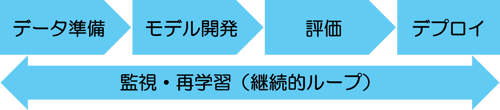

開発ライフサイクルの違い

従来ITのソフトウェア開発ライフサイクル

AIの機械学習ライフサイクル

困難を乗り越え、成功へ導くために

AI導入の課題は乗り越えられない壁ではありません。戦略的なアプローチによって、AIの可能性を組織の力に変えることができます。

明確なAI戦略と経営層のコミットメント

AI導入を技術課題ではなく経営課題と捉え、明確なビジネス目標と連携した戦略を立てることが全ての出発点です。経営層は、AIの可能性と限界を理解し、変革を推進する強力なリーダーシップと持続的なリソース投下を約束する必要があります。

データリテラシーとAI活用に適した文化の醸成

専門家だけでなく、全従業員がデータを理解し、AIを「仕事を奪う脅威」ではなく「能力を拡張する協調相手」と認識する文化が必要です。実験を奨励し、失敗から学ぶことを許容する柔軟な組織文化がイノベーションの土壌となります。

反復的アプローチとスモールスタート

最初から大規模なプロジェクトを目指すのではなく、特定の課題に絞った小規模なPoC(概念実証)から始めるべきです。短期間で「小さな成功体験」を積み重ねることが、組織全体の理解を深め、導入への心理的ハードルを下げます。

体系的なチェンジマネジメント(変革管理)

AI導入がもたらす業務や役割の変化に対し、従業員の不安を和らげ、新しい働き方への移行を支援する計画的な取り組みが不可欠です。明確なコミュニケーション、従業員の関与、十分なトレーニング機会の提供が鍵となります。

価値への集中と継続的な学習

AI導入自体が目的ではありません。常にビジネス価値への貢献を意識し、ROIを見極める必要があります。また、技術は日進月歩であり、組織として最新動向を学び、戦略を柔軟に見直していくアジャイルな姿勢が求められます。